OpenClaw Gemini API 接入最新教程(附AI API 统一网关使用方式)

广告:如果你不想分别维护 Gemini、GPT、Claude 多套接口,可以直接用 api.clawsocket.com。一套 Key 就能把 OpenClaw 接到统一的AI API 统一网关上,后面切模型和扩模型都会轻松很多。

如果你现在正在折腾 OpenClaw Gemini API,大概率会遇到几个很典型的问题:

- OpenClaw 到底是直接接 Google 官方 API,还是接AI API 统一网关

GEMINI_API_KEY应该放环境变量,还是写进openclaw.json- 为什么 dashboard 能打开,但 Gemini 模型就是不出字

- 如果后面还想继续接 GPT、Claude、Grok,是不是又要重配一遍

这篇文章就专门解决这些问题。你可以把它理解成一篇从“先把 Gemini 跑起来”到“顺手把多模型入口统一起来”的完整实操稿。重点不只是讲 OpenClaw Gemini API 怎么接,还会讲AI API 统一网关在 OpenClaw 里到底怎么配、什么时候更适合用、怎么验证是不是已经真的生效。

快速结论

- 截至

2026-03-23,OpenClaw 官方文档仍然支持原生 Google provider,也支持通过models.providers接自定义 Gemini 入口 - 如果你只想把

OpenClaw Gemini API先跑通,最快的方式通常是先完成openclaw onboard,再补 Key 或 provider 配置 - 如果你只用 Gemini,一个

GEMINI_API_KEY就够了;如果你还想把 GPT、Claude、Grok 一起接进来,AI API 统一网关会更省心 - 用 api.clawsocket.com 这类统一入口时,OpenClaw Gemini API 最省事的写法通常是

openai-completions兼容模式 - 无论你走官方路线还是走AI API 统一网关,最终都要回到

openclaw.json、环境变量和 Gateway 验证这三步

OpenClaw Gemini API 适合哪两种接法

OpenClaw Gemini API 常见其实就两条路。第一条是 Google 官方 API 路线。也就是你去 Google AI Studio 或 Google 生态里拿自己的 Key,然后让 OpenClaw 直接调用 Google 提供的 Gemini 接口。优点是链路直接,字段语义清楚,和官方文档最一致;缺点也很明显,如果你后面还想把 GPT、Claude、Grok 一起接进 OpenClaw,就会开始维护多把 Key、多种 provider 和多套模型入口。第二条是AI API 统一网关路线。也就是通过一个统一入口把 Gemini、GPT、Claude、Grok 等模型放到同一套接入层里,再让 OpenClaw 只认这一个 provider。对很多开发者来说,这条路更贴近日常需求,因为项目真正需要的不是“只接一个 Gemini”,而是“以后切模型也别重新来一遍”。

如果你现在只是做最小可用测试,官方路线当然能跑;但如果你本来就有多模型计划,或者你已经在同时使用 OpenClaw、Codex、Claude Code 这类工具,那么一开始就把 OpenClaw Gemini API 放到统一的AI API 统一网关里,通常会更省时间。

方式一:通过 api.clawsocket.com 接入 OpenClaw Gemini API

这条路线是我更推荐的,因为它最贴近真实使用场景。你不是单独给 Gemini 配一套链路,而是顺手把 OpenClaw 后面的多模型入口统一了。

AI API 统一网关 的核心价值主要有三点:一个入口就能同时接 Gemini、GPT、Claude、Grok;你不用为每个 provider 单独维护不同风格的配置;后面扩模型时,基本还是在同一个 provider 里继续加模型。在 OpenClaw 里做这件事,思路很简单:先拿到你在 api.clawsocket.com 的 API Key,再把它写进环境变量,最后在 models.providers 里声明一个自定义 provider。

第 1 步:生成你的 API Key

- 登录 api.clawsocket.com

- 打开

令牌管理 - 点击

添加令牌 - 分组选择

default - 生成并复制 Key

拿到以后,优先写进环境变量,不要直接把密钥长期硬编码在文件里:

bash

export CLAWSOCKET_API_KEY="你的 API Key"

echo 'export CLAWSOCKET_API_KEY="你的 API Key"' >> ~/.zshrc

source ~/.zshrc如果你现在用的是 PowerShell,也可以先做当前会话测试:

powershell

$env:CLAWSOCKET_API_KEY="你的 API Key"这一小步看起来很基础,但对 OpenClaw Gemini API 很重要。因为你一旦把 Key 放进环境变量,后面无论你接 Gemini 还是切 GPT、Claude,本质上都还是在复用同一套凭证管理方式。

第 2 步:在 openclaw.json 里声明 Gemini provider

bash

openclaw config file通常默认路径是 Windows 的 C:\Users\你的用户名\.openclaw\openclaw.json,或者 macOS / Linux 的 ~/.openclaw/openclaw.json。然后把 OpenClaw Gemini API 配成下面这种结构:

json5

{

agents: {

defaults: {

workspace: "~/.openclaw/workspace",

model: {

primary: "clawsocket/gemini-2.5-flash",

fallbacks: [

"clawsocket/gpt-5.4",

"clawsocket/claude-sonnet-4-5"

]

},

models: {

"clawsocket/gemini-2.5-flash": {},

"clawsocket/gemini-2.5-pro": {},

"clawsocket/gpt-5.4": {},

"clawsocket/claude-sonnet-4-5": {},

"clawsocket/grok-4": {}

}

}

},

models: {

mode: "merge",

providers: {

clawsocket: {

baseUrl: "https://api.clawsocket.com/v1",

apiKey: "${CLAWSOCKET_API_KEY}",

api: "openai-completions",

models: [

{ id: "gemini-2.5-flash", name: "Gemini 2.5 Flash", contextWindow: 1000000 },

{ id: "gemini-2.5-pro", name: "Gemini 2.5 Pro", contextWindow: 2000000 },

{ id: "gpt-5.4", name: "GPT-5.4" },

{ id: "claude-sonnet-4-5", name: "Claude Sonnet 4.5" },

{ id: "grok-4", name: "Grok 4" }

]

}

}

}

}这套配置的逻辑其实不复杂。baseUrl 指向你的AI API 统一网关入口,apiKey 从环境变量里取,api 告诉 OpenClaw 用 OpenAI 兼容方式发请求,primary 决定默认先跑哪个 Gemini 模型。只要你把这四层关系想清楚,OpenClaw Gemini API 后面的扩展就不会乱。

第 3 步:为什么这里推荐AI API 统一网关

因为对实际开发来说,Gemini 很少是唯一模型。你很可能今天先让 OpenClaw Gemini API 跑起来,明天就想比较 GPT-5.4 的写作效果,后天又想拿 Claude 看长文本,或者拿 Grok 做对照测试。如果每切一次模型都要重建一套配置,那维护成本会迅速上升。

用AI API 统一网关 的好处就在这里。你可以先把 Gemini 作为默认主力模型,然后把 GPT、Claude、Grok 都放进同一个 provider。当你在 OpenClaw 里切默认模型、加 fallbacks、或者临时做对比测试时,心智成本会明显低很多。

方式二:直接使用 Google 官方 OpenClaw Gemini API

如果你更想按官方链路来做,也完全可以。根据 OpenClaw 官方文档,Google Gemini 的 provider 认证环境变量是 GEMINI_API_KEY,CLI 上也支持 openclaw onboard --auth-choice gemini-api-key 这种思路。

这条路更适合两类人:你现在只想把 OpenClaw Gemini API 单独跑起来,或者你还没有统一多模型入口的计划,先追求最短官方链路。

官方路线怎么拿 Key

最常见的做法是去 Google AI Studio 创建 Gemini API Key,然后把它放进环境变量里:

bash

export GEMINI_API_KEY="你的 Gemini API Key"

openclaw onboard --auth-choice gemini-api-key如果你已经跑完了向导,也可以直接在配置里补:

json5

{

env: {

GEMINI_API_KEY: "AIza..."

},

agents: {

defaults: {

model: {

primary: "google/gemini-3-pro-preview"

}

}

}

}这里有一个很重要的区别。走 Google 官方 OpenClaw Gemini API 时,OpenClaw 识别的是内置 provider,例如 google/*。走AI API 统一网关时,你通常写的是自定义 provider,例如本文里的 clawsocket/*。两者都能跑,但后者更适合后续继续扩多模型。

官方路线的优点和限制

官方 OpenClaw Gemini API 最大的优点是简单直接。你看官方文档、拿官方 Key、配官方 provider,路径非常清晰。

但限制也一样明显:如果你后面还想把 GPT、Claude、Grok 一起接到 OpenClaw,配置会开始变散。你得维护多种 provider、不同命名空间、不同 Key,后续切换时也没有统一入口那么干净。

所以如果你的目标只是验证 Gemini 能不能在 OpenClaw 里跑,官方路线没问题;但如果你的目标是长期使用,我还是更建议一开始就把 OpenClaw Gemini API 接进你的AI API 统一网关。

方式三:自己接一个自定义 Gemini 兼容入口

如果你手里不是 api.clawsocket.com,而是另一套自建兼容网关、代理层或者团队内部统一入口,OpenClaw 也能接。思路和AI API 统一网关本质上一样,核心还是 models.providers。

示意配置如下:

json5

{

agents: {

defaults: {

model: {

primary: "custom-gemini/gemini-2.5-flash"

}

}

},

models: {

mode: "merge",

providers: {

"custom-gemini": {

baseUrl: "https://your-proxy.example.com/v1",

apiKey: "${CUSTOM_GEMINI_API_KEY}",

api: "openai-completions",

models: [

{ id: "gemini-2.5-flash", name: "Gemini 2.5 Flash", contextWindow: 1000000 }

]

}

}

}

}这类接法的本质和前面的 clawsocket 没区别。差别只在于,本文推荐的AI API 统一网关 已经可以直接把 Gemini、GPT、Claude、Grok 放进同一条入口里,所以没必要先绕远路去造重复配置。

OpenClaw Gemini API 怎么验证是否已经生效

不要只看文件保存成功。OpenClaw Gemini API 真正有没有跑通,要按下面这条顺序验证:

bash

openclaw config validate

openclaw doctor

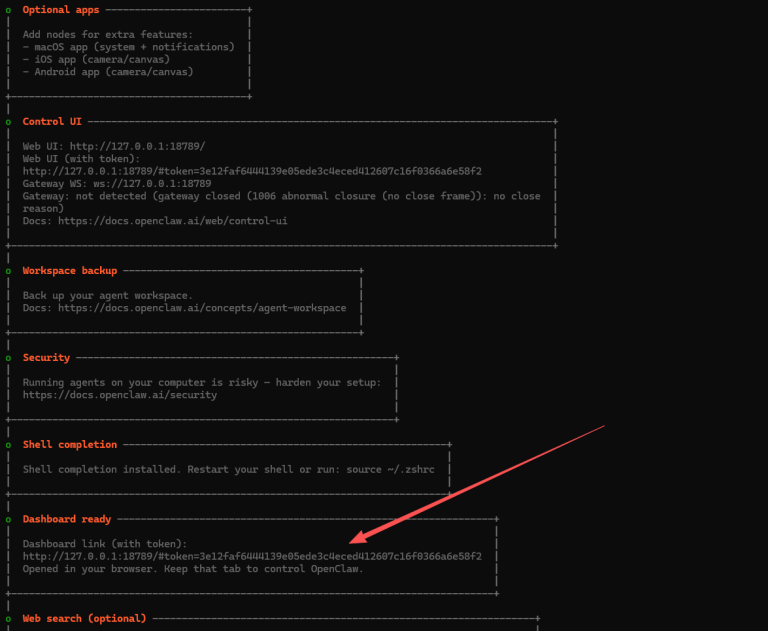

openclaw gateway

openclaw dashboard如果你更习惯后台模式,也可以把 openclaw gateway 换成 openclaw gateway start。关键不是前台还是后台,而是你要确认 Gateway 读取到了最新配置和最新环境变量。

| 检查项 | 你要看什么 | 目的 |

|---|---|---|

| 配置校验 | openclaw config validate 是否通过 | 排除 JSON5 和字段层级错误 |

| 环境变量 | echo $CLAWSOCKET_API_KEY 或 echo $GEMINI_API_KEY | 确认 Key 已注入 |

| 模型入口 | baseUrl 是否正确、provider 名称是否一致 | 确认请求会发到正确位置 |

| 对话结果 | dashboard 是否正常返回内容 | 验证 OpenClaw Gemini API 已能实际工作 |

很多人会把这一步忽略掉,然后误以为“Dashboard 打开了就等于成功了”。实际上不是。Dashboard 只能说明 Gateway 已经起来,真正决定 OpenClaw Gemini API 会不会返回内容的,还是 provider、Key、模型 id 和请求入口。

OpenClaw Gemini API 常见问题排查

1. 401 / API Key 无效

这种问题最常见,优先检查 3 件事:Key 是否复制错了,环境变量是不是当前进程能读到,以及你是不是还在用旧的 Gateway 进程验证新配置。尤其是AI API 统一网关 场景,最容易出现的不是字段写错,而是 Key 已经换了但 Gateway 还没重启。

2. 模型名存在,但切换失败

如果你在 agents.defaults.models 里设置了允许列表,那么不在列表里的模型就算 provider 已经配好,也可能切不过去。这类问题看起来像 OpenClaw Gemini API 失效,实际上是 allowlist 没放行。

3. 控制台能开,但消息不返回

这通常说明安装层已经没问题,阻塞点在模型入口层。先回头检查 baseUrl、apiKey、api 适配器和默认模型名,再看是不是用了旧 token、旧进程或者旧环境变量。

4. 为什么我明明只想接 Gemini,却还是建议用AI API 统一网关

因为你现在只接 Gemini,不代表后面永远只用 Gemini。对大多数开发者来说,一开始就把 OpenClaw Gemini API 放进统一入口,后面切到 GPT、Claude、Grok 的成本会低很多。这就是AI API 统一网关 真正的价值,不只是省一步配置,而是省掉未来很多次重复配置。

官方 API 和AI API 统一网关怎么选

把这件事简单拆开,其实很清楚:你只想快速验证 OpenClaw Gemini API 能不能工作,用 Google 官方 Key 就够;你准备长期用 OpenClaw,而且以后还要接 GPT、Claude、Grok,更适合用AI API 统一网关;你已经在别的工具里用了统一入口,那 OpenClaw Gemini API 最好也一起对齐,后面维护会轻松很多。从工程角度看,统一入口的优势不在“某一次配置更炫”,而在于你后面不用一直重复做同样的工作。这也是为什么我更推荐你直接用 api.clawsocket.com 来承接 OpenClaw Gemini API。

总结

如果你只想知道 OpenClaw Gemini API 怎么接,答案其实很简单:要么走 Google 官方 Key,要么走统一的AI API 统一网关。前者更直接,后者更适合长期维护和多模型扩展。

对大多数开发者来说,更实用的路线通常是:先把 OpenClaw 装好并跑完 openclaw onboard,再去 api.clawsocket.com 生成自己的 API Key,把 Key 放进环境变量,在 openclaw.json 里按本文方式声明 clawsocket provider,把 Gemini 设成默认模型,再把 GPT、Claude、Grok 一起列入模型表,最后用 Dashboard 和 Gateway 验证这条链路已经真正跑通。只要这条主线走通,你拿到的就不只是一个能跑的 OpenClaw Gemini API,而是一套后面还能继续扩模型的AI API 统一网关接入框架。

实际使用时,怎么让这套配置更稳

很多人第一次把 Gemini 接进 OpenClaw 时,关注点全在“能不能返回内容”,却忽略了后面维护时最容易出的问题。真正进入日常使用以后,最常见的麻烦往往不是接口完全挂掉,而是改过 Key、改过模型、改过默认 provider 之后,自己已经忘了当前到底是哪一份配置在生效。这时候如果没有一个固定动作,你每次排查都要从头猜一遍,效率会很差。

更稳的做法是把当前能用的 openclaw.json 留一个脱敏备份,并记录当时的默认模型、环境变量名和入口地址。这样下次你调整 Gemini 默认模型、临时切换到 GPT 或 Claude,或者替换 Key 以后,只要发现对话结果不对,就能很快对照出到底是 provider 结构变了、环境变量没读到,还是只是当前默认模型不是你以为的那一个。对个人开发者来说,这能明显减少重复排查;对团队来说,这也更适合作为统一模板发给其他人复用。

另外一个实用建议是,不要把“测试状态”和“长期状态”混在一起。很多人在试模型时会把 primary 改来改去,等几天以后再回来用,却忘了自己之前做过哪些临时调整。更好的方式是先固定一个稳定默认模型,例如 gemini-2.5-flash 或 gemini-2.5-pro,再把 GPT、Claude、Grok 作为同一个 provider 下的备用模型。这样你既保留了 OpenClaw Gemini API 的主线体验,也不会因为频繁切换而把配置搞乱。

广告:如果你想一步到位把 OpenClaw Gemini API、GPT、Claude、Grok 放进同一条入口,可以直接使用 api.clawsocket.com。这比后面再一点点拆散重配,更省时间。